BIJLAGE boek Menswaardige AI Hoofdstuk 5; Menswaardige Menskompas Methode (SER) #maih5004

AI begint in veel organisaties op dezelfde manier als eerdere technologische vernieuwingen: met ambitie, tempo en optimisme. Er worden tools aangeschaft, proefprojecten opgezet en strategieën aangekondigd. Alles lijkt in beweging. Toch loopt een opvallend groot deel van die trajecten vast. Niet omdat de technologie tekortschiet, maar omdat de invoering ervan te smal wordt bekeken. Medewerkers weten vaak niet precies wat een systeem doet, laat staan wat het betekent voor hun werk. Processen veranderen nauwelijks, terwijl de context wél verschuift. Doelen blijven vaag, waardoor onduidelijk is of AI werkelijk iets verbetert. De technologie functioneert dan misschien, maar de organisatie eromheen nog niet. En precies daar zit het probleem: AI faalt zelden op techniek, maar vaak op integratie.

In het boek Menswaardige AI werd al duidelijk dat AI nooit neutraal is. Elk systeem leert van menselijke keuzes, bestaande data en historische patronen en neemt dus ook menselijke vooroordelen en scheefgroei mee. Praktijkvoorbeelden, van Unilever tot Google Maps en van IKEA tot de zorg, laten in het boek zien wat menswaardige AI in de praktijk betekent: technologie die ondersteunt, uitlegbaar is en de mens aan het stuur laat. De rode draad daarin is human oversight: menselijke eindcontrole over AI-beslissingen.

De keerzijde is minstens zo leerzaam. De toeslagenaffaire en het stopgezette SyRI-systeem tonen wat er misgaat wanneer algoritmes zonder transparantie, ethische kaders of menselijke controle worden ingezet. Zulke voorbeelden maken duidelijk dat verantwoorde AI niet vanzelf ontstaat. Ze moet bewust worden ontworpen, georganiseerd en bewaakt.

Daarom groeit de behoefte aan een aanpak die verder gaat dan techniek alleen.

Van losse richtlijnen naar een samenhangende 3M-methode

In de afgelopen jaren zijn er allerlei modellen en kaders ontwikkeld om AI zorgvuldiger te implementeren. Denk aan human-in-the-loop, augmented work, governance-structuren, het PACE-model van de Nederlandse AI Coalitie en praktische checklists rond data, bias en toezicht. Al die benaderingen dragen iets belangrijks bij. Ze laten zien dat succesvolle AI vraagt om menselijke regie, transparantie, duidelijke rolverdeling, toetsing en blijvend leren. Tegelijk bleek in de praktijk dat veel van die inzichten versnipperd werden toegepast.

Hier een checklist, daar een governance-overleg, ergens anders een ethische discussie maar zelden een aanpak die alles met elkaar verbindt: waarden, organisatie, ontwerp, impact, toezicht en leren.

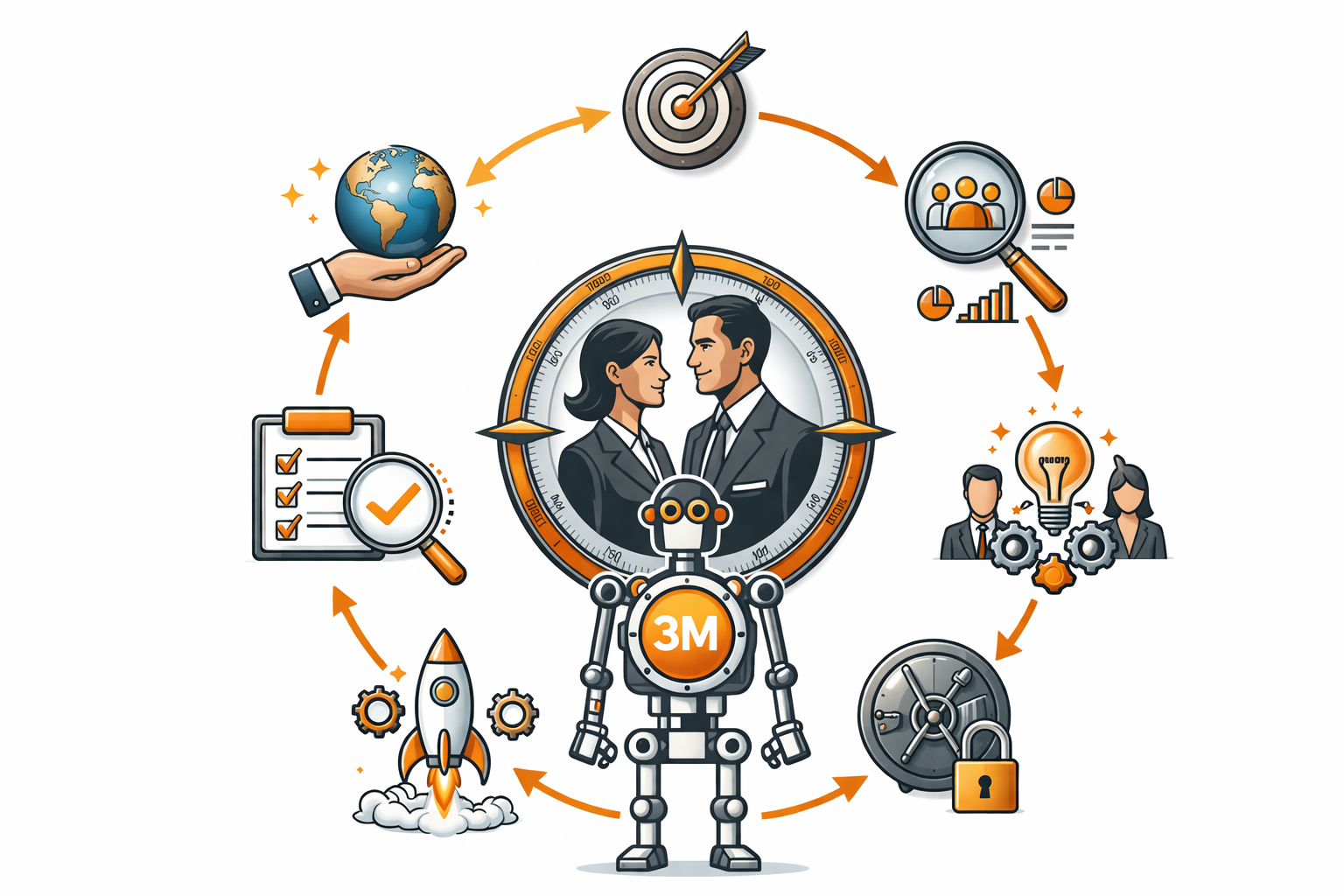

Vanuit die behoefte ontstond de Menswaardige Menskompas Methode ©, kortweg de 3M-methode.

Het ontstaan van de 3M-methode en de 7 inzichten

De 3M-methode is niet ontstaan vanuit theorie alleen, maar vanuit een terugkerende praktijkvraag: hoe implementeer je AI zó, dat technologie niet losraakt van menselijke waardigheid, professionele autonomie en maatschappelijke verantwoordelijkheid?

Die vraag kwam steeds terug in de analyse van praktijkcases. Of het nu ging om recruitment, klantenservice, zorg, publieke dienstverlening, onderwijs of financiële dienstverlening: steeds bleek hetzelfde. De doorslaggevende factor was niet of een model technisch indrukwekkend was, maar of de organisatie vooraf had nagedacht over waarden, context, verantwoordelijkheden en gevolgen voor mensen.

Uit die praktijklessen ontstond de behoefte aan een kompas. Geen abstract moreel verhaal, maar een werkbare methode. Geen afvinklijst, maar een denkkader én handelingsmodel dat richting geeft aan ontwerp, implementatie en evaluatie.

De Menswaardige Menskompas Methode © bouwt daarom voort op zeven basale inzichten uit de praktijk:

- begin bij waarden en doelen, niet bij technologie

- de kwaliteit van data bepaalt de kwaliteit van uitkomsten

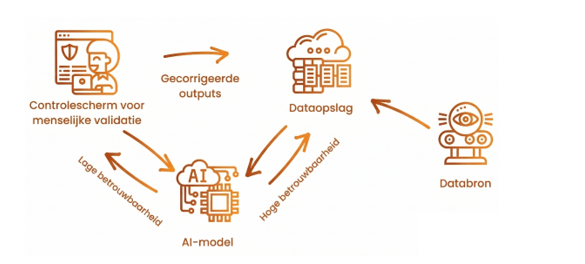

- menselijke controle is essentieel voor vertrouwen

- transparantie en uitlegbaarheid zijn voorwaarden, geen luxe

- governance en eigenaarschap voorkomen willekeur

- context en menselijke impact zijn net zo belangrijk als performance

- AI-implementatie is een continu leerproces, geen eenmalige uitrol

Precies daaruit groeide de 3M-methode: als een antwoord op de kloof tussen technische innovatie en menselijke verantwoordelijkheid.

Wat is de 3M-methode?

De Menswaardige Menskompas Methode © is een praktische aanpak voor organisaties die AI niet alleen slim, maar ook zorgvuldig, rechtvaardig en betekenisvol willen inzetten. De methode behandelt AI niet als een losstaande tool, maar als een veranderproces waarin technologie, cultuur, ethiek, leiderschap en organisatie samenkomen.

Het uitgangspunt is helder: niet wat AI kan, maar wat AI doet met mensen, werk, vertrouwen en besluitvorming, staat centraal.

De methode wil organisaties helpen om AI menswaardig in te voeren. Dat betekent: met respect voor menselijke autonomie, met aandacht voor inclusie en rechtvaardigheid, met transparantie over keuzes en met ruimte voor menselijke correctie.

De vijf kernwaarden van de 3M-methode

De vijf kernwaarden van de 3M-methode

Onder de methode liggen vijf vaste kernwaarden. Zij vormen het morele kompas van elk AI-traject.

1. Menselijkheid en autonomie

AI mag mensen niet reduceren, manipuleren of ongemerkt de regie overnemen. Mensen moeten invloed houden op besluiten die hen raken.

2. Robuustheid en veiligheid

Een systeem moet betrouwbaar, controleerbaar en veilig functioneren. Dat vraagt ook om noodscenario’s, toezicht en duidelijke procedures bij fouten.

3. Gelijkheid en rechtvaardigheid

Bias en uitsluiting moeten actief worden opgespoord en tegengegaan. Eerlijke uitkomsten ontstaan niet vanzelf; ze vragen om bewuste keuzes.

4. Transparantie en verantwoordelijkheid

Gebruikers en bestuurders moeten kunnen begrijpen hoe een systeem werkt, welke aannames erin zitten en wie verantwoordelijk is voor de uitkomsten.

5. Democratische waarden en mensenrechten

Niet alles wat technisch mogelijk is, is ook wenselijk. AI moet passen binnen privacy, rechtsbescherming, waardigheid en democratische beginselen.

Deze vijf waarden maken van de 3M-methode geen technische aanpak met een ethisch sausje, maar een normatief vertrekpunt voor verantwoorde implementatie.

De 3M-methode in zeven onderdelen

De methode bestaat uit zeven samenhangende onderdelen. Ze helpen organisaties om AI niet te behandelen als een lineair IT-project, maar als een zorgvuldig opgebouwd veranderproces.

1. Definieer waarden en doelen

Elke menswaardige AI-implementatie begint met een fundamentele vraag: waarom doen we dit, voor wie, en welk probleem lossen we werkelijk op?

Dat klinkt vanzelfsprekend, maar in de praktijk starten veel organisaties met een tool in plaats van met een bedoeling. De 3M-methode draait dat om. Eerst komt de vraag naar de maatschappelijke, menselijke en organisatorische waarde. Pas daarna volgt de techniek.

Dat betekent: stakeholders in kaart brengen, kernwaarden expliciet maken, doelen meetbaar formuleren en spanningen benoemen — bijvoorbeeld tussen efficiëntie en rechtvaardigheid. Een AI-toepassing is pas zinvol als zij niet alleen sneller werkt, maar ook vertrouwen versterkt, menselijke autonomie respecteert en daadwerkelijk bijdraagt aan een beter proces.

2. Analyseer context en impact

AI landt nooit in een leegte. Ze komt terecht in een werkelijkheid van medewerkers, klanten, burgers, patiënten, studenten, managers en machtsverhoudingen.

Daarom vraagt de tweede stap om een serieuze contextanalyse. Wie wordt geraakt? Wie profiteert? Wie loopt risico? Versterkt het systeem bestaande ongelijkheid, of maakt het processen juist eerlijker? Vergroot het de handelingsruimte van professionals, of duwt het hen richting automatische opvolging?

De 3M-methode benadrukt dat implementatie alleen menswaardig kan zijn als de menselijke werkelijkheid serieus wordt genomen. Niet als bijzaak, maar als vertrekpunt.

3. Ontwerp mensgericht

Pas als waarden en context scherp zijn, komt het ontwerp in beeld. Ook dan blijft de centrale vraag dezelfde: ondersteunt het systeem de mens, of duwt het de mens naar de rand van het proces?

Mensgericht ontwerpen betekent co-creatie. Eindgebruikers worden vroeg betrokken, niet pas achteraf. Professionals moeten kunnen begrijpen, beoordelen en corrigeren wat het systeem doet. AI moet ondersteunen, niet overheersen.

In de zorg betekent dat dat een arts geholpen wordt, maar nooit buitenspel raakt. In organisaties betekent het dat medewerkers versterkt worden in hun werk, niet gedegradeerd tot uitvoerders van modeluitkomsten.

4. Maak keuzes transparant

Veel wantrouwen rond AI ontstaat niet eens door de uitkomst zelf, maar door onduidelijkheid eromheen. Welke data zijn gebruikt? Welke aannames zitten in het model? Wat kan het systeem wel en wat juist niet?

Daarom is transparantie een aparte stap in de methode. Organisaties moeten keuzes documenteren, beperkingen benoemen en systemen uitlegbaar maken. Een AI-toepassing mag geen zwarte doos worden waar niemand grip op heeft. Uitlegbaarheid is daarbij geen luxe voor experts, maar een basisvoorwaarde voor legitiem gebruik.

5. Beveilig en borg

Een goed model is nog geen goed ingebedde toepassing. Zonder eigenaarschap, toezicht en governance ontstaat al snel een situatie waarin iedereen AI gebruikt, maar niemand zich echt verantwoordelijk voelt. De 3M-methode vraagt daarom om formele borging: wie beheert het systeem, wie controleert op bias en betrouwbaarheid, wie grijpt in bij fouten, en wie mag besluiten tot aanpassing of stopzetting?

Juist hier wordt zichtbaar of AI wordt gezien als een los experiment of als een serieus bestuurlijk vraagstuk.

6. Start en begeleid de pilot

Na ontwerp en borging volgt de praktijkproef. De pilotfase is in de 3M-methode geen vrijblijvende test, maar een cruciale werkelijkheidstoets.

In een afgebakende omgeving wordt gekeken of het systeem niet alleen technisch werkt, maar ook menswaardig functioneert. Gebruikers zijn in deze fase geen proefkonijnen, maar actieve gesprekspartners. Hun ervaringen laten zien waar het schuurt, waar het werkt en waar aannames moeten worden bijgesteld.

Pas als de pilot bewijst dat de toepassing betrouwbaar, werkbaar en verantwoord is, komt opschaling in beeld.

7. Evalueer en leer continu

Menswaardige AI is nooit af. Wetgeving verandert, gebruikers veranderen, context verandert en systemen gedragen zich in de praktijk vaak anders dan op papier.

Daarom eindigt de 3M-methode niet met uitrol, maar met leren. Organisaties moeten feedback ophalen, incidenten registreren, ongewenste effecten serieus nemen en systemen blijven aanpassen. Niet eenmalig, maar structureel.

Dat maakt de methode fundamenteel anders dan een klassieke projectaanpak. Zij ziet implementatie niet als eindpunt, maar als een voortdurend leerproces.

Waarom deze methode werkt

De kracht van de 3M-methode zit in de combinatie van eenvoud en diepgang. De methode is praktisch genoeg om toe te passen, maar breed genoeg om niet te vervallen in techniekdenken. Ze dwingt organisaties om andere vragen te stellen.

Niet alleen: werkt het?

Maar ook: voor wie werkt het?

Onder welke voorwaarden?

Wie loopt risico?

Wie houdt de regie?

En: wat betekent deze toepassing voor menselijke waardigheid, rechtvaardigheid en vertrouwen?

Precies daardoor verschuift het perspectief. AI wordt dan niet langer gezien als een tool die je uitrolt, maar als een ingreep die gevolgen heeft voor mensen, werk en samenleving.

Van implementatiekader naar moreel kompas

Wat de 3M-methode onderscheidt van veel andere modellen, is niet alleen de opbouw, maar vooral de blikrichting. Deze methode behandelt AI niet als neutrale innovatie, maar als een keuze met normatieve gevolgen. Daarmee verschuift de aandacht:

- van implementeren naar verantwoorden,

- van optimaliseren naar afwegen,

- van snelheid naar zorgvuldigheid.

Dat is geen pleidooi tegen innovatie. Het is een pleidooi voor volwassen innovatie. Voor een manier van werken die niet alleen kijkt naar wat kan, maar ook naar wat klopt.

Het echte resultaat van de 3M-methode

Eigenlijk is het woord eindproduct misleidend. Menswaardige AI is geen eindpunt dat je bereikt, maar een proces van voortdurend balanceren. Tussen efficiëntie en rechtvaardigheid. Tussen innovatie en bescherming. Tussen systeemlogica en menselijke maat.

De Menswaardige Menskompas Methode © biedt daarvoor geen simpel recept, maar wel iets waardevollers: richting.

Ze helpt organisaties om technologie niet alleen slimmer, maar ook zorgvuldiger, eerlijker en menselijker te maken. En daarin ligt misschien wel de werkelijke belofte van AI: niet dat machines steeds meer kunnen, maar dat mensen beter worden ondersteund in wat hen mens maakt.

–

#maih5004, maih5004